AI generativa per team .NET che vogliono casi d'uso reali, controllo e margine

Qui trovi come portare LLM, agenti e AI generativa dentro prodotti e processi .NET con un criterio tecnico chiaro: meno hype, piu integrazione, piu affidabilita, piu ritorno reale.

Gli LLM non sono chatbot: sono componenti architetturali che cambiano i prodotti

Quando un team scopre che può chiamare GPT-4 da un controller ASP.NET in tre righe di codice, la prima reazione è di entusiasmo.

La seconda, qualche settimana dopo, è di confusione: il modello alucina, i costi scalano in modo imprevedibile, l'utente non capisce cosa sta succedendo e il sistema non è testabile.

Il problema non è il modello.

Il problema è che un LLM non è una funzione deterministica: è un componente probabilistico con latenza variabile, costi proporzionali al volume di testo elaborato e comportamento dipendente dal contesto fornito.

Integrarlo in un prodotto reale richiede le stesse decisioni architetturali che si prendono per qualsiasi componente critico: dove sta il confine di responsabilità, come si gestisce il fallimento, come si monitora il comportamento in produzione.

In questa categoria trovi esattamente questo: non tutorial per chiamare un'API, ma ragionamenti su come inserire gli LLM in sistemi reali con Semantic Kernel, RAG, agenti e function calling, tenendo il controllo su costi, affidabilità e qualità dell'output.

Semantic Kernel, agenti e pipeline: cosa usare e quando

L'ecosistema AI .NET si è consolidato attorno a Semantic Kernel come framework di orchestrazione principale.

Non è l'unica opzione, ma è quella con il maggiore supporto Microsoft, la migliore integrazione con Azure OpenAI e la comunità più attiva nell'ecosistema .NET.

Quando usare Semantic Kernel: quando hai bisogno di comporre più chiamate al modello, gestire memoria conversazionale, integrare plugin e tool, o costruire agenti che ragionano su più passi. Semantic Kernel è overengineering per una singola chiamata isolata.

Quando usare l'SDK OpenAI diretto: quando vuoi controllo totale sul payload, hai requisiti specifici di streaming o function calling che Semantic Kernel non espone bene, o stai costruendo un wrapper personalizzato per il tuo team.

Quando costruire agenti: quando il problema richiede che il sistema decida autonomamente quali tool chiamare, in quale ordine, e sulla base di quale ragionamento. Gli agenti sono potenti ma fragili: richiedono prompt engineering rigoroso, fallback espliciti e monitoraggio continuo.

Quando non usare un LLM: quando il problema è deterministico, quando la latenza è critica, quando i dati non possono uscire dall'infrastruttura e un modello locale non è sufficiente, o quando il costo per query non è sostenibile nel modello di business.

Costi, latenza e affidabilità: i tre vincoli che cambiano tutto

Chi costruisce un prototipo con un LLM non ha mai il problema dei costi.

Chi porta quel prototipo in produzione, sì.

I token costano.

Una pipeline RAG con retrieval, reranking e generazione può costare da cinque a cinquanta volte una semplice chiamata.

Moltiplicata per migliaia di richieste al giorno, quella differenza diventa un problema di margine.

Il design del sistema deve tenerne conto: prompt più corti, caching delle risposte, chunking intelligente dei documenti, scelta del modello giusto per la complessità del task.

La latenza è il secondo vincolo.

Un'interfaccia utente che aspetta tre secondi la risposta di un LLM senza feedback visivo perde utenti.

Lo streaming delle risposte risolve la percezione, ma non il problema strutturale: alcune pipeline semplicemente non possono essere rese abbastanza veloci per certi contesti d'uso.

L'affidabilità è il terzo.

I modelli allucinano.

Non sempre, non spesso, ma abbastanza da rendere necessario un sistema di validazione dell'output quando il risultato ha impatto su decisioni o dati critici.

Valutazione automatica, feedback umano in loop e fallback su logica deterministica non sono optional in produzione.

| Vincolo | Strategia di mitigazione | Strumento .NET |

|---|---|---|

| Costo token | Prompt compression, caching, modello più piccolo | Semantic Kernel, cache distribuita |

| Latenza | Streaming, parallelizzazione, precompute | HttpClient streaming, Task.WhenAll |

| Affidabilità | Output validation, retry con diverso prompt | Semantic Kernel filters, Polly |

Come costruire un prodotto AI che scala oltre la demo

La differenza tra una demo che impressiona e un prodotto che funziona in produzione si misura in mesi di lavoro su aspetti che nessun tutorial mostra.

Il primo è l'osservabilità: sapere cosa ha chiesto l'utente, quale contesto è stato iniettato nel prompt, cosa ha risposto il modello e quanto tempo ci ha messo.

Senza questi dati non puoi migliorare il sistema né diagnosticare i fallimenti.

Il secondo è la testabilità: un sistema che chiama un LLM non è testabile con unit test tradizionali, ma si può progettare con interfacce sostituibili, mock del modello per i test funzionali e valutazione automatica dell'output su dataset di riferimento.

Il terzo è la governance: chi può fare cosa con il sistema AI, quali dati entrano nel contesto, come si gestisce il consenso degli utenti, cosa succede quando il modello produce output inappropriato.

Queste non sono domande tecniche: sono domande di prodotto e compliance che il team tecnico deve saper sollevare prima che diventino problemi.

In questa categoria gli articoli affrontano esattamente questi aspetti: non la magia dell'AI, ma l'ingegneria che la rende utile e sostenibile.

Analisi, casi e articoli su LLM, agenti AI e integrazione nelle applicazioni .NET

32 articoli trovatiIl protocollo che connette il tuo codice .NET all'intelligenza artificiale

Creare un MCP Server in .NET con l'SDK ufficiale Anthropic. Guida pratica con esempi C# per connettere i tuoi dati aziendali all'AI nel 2026.

Come portare l'intelligenza artificiale nei processi produttivi reali con MCP e .NET

Agenti AI in .NET con MCP per il manifatturiero: connetti SCADA, MES ed ERP all'intelligenza artificiale. Architettura, esempi e roadmap in 90 giorni.

MCP: il protocollo che cambia come i tuoi strumenti parlano con l'AI

Cos'è il Model Context Protocol, perché sta diventando uno standard e come creare un MCP server in C# e .NET con esempi pratici.

Copilot, Cursor o Claude Code: quale AI da coding vale davvero i soldi nel 2026

Confronto reale tra GitHub Copilot, Cursor e Claude Code nel 2026. Quale scegliere in base a task, budget e lavoro quotidiano su progetti .NET.

Vibe coding: cosa cambia davvero per chi fa software ogni giorno

Cos'è il vibe coding, quando funziona e quando no. Guida concreta con esempi reali per developer professionisti che lavorano con AI nel 2026.

Usa la hybrid search se vuoi smettere di avere risultati quasi giusti

I segnali che ti serve la hybrid search: ranking instabile, token ignorati, risultati imprecisi. Soluzioni tra keyword search, embedding e re-ranking

Software come asset o costo? Quanti soldi perdi davvero ogni mese?

Scopri perché parlare di software come asset cambia stime e rischio aziendale. Criteri pratici, indicatori e scelte che rendono il codice capitale

Qual è la migliore AI per programmare senza perdere il controllo

Scopri la migliore AI per programmare nel 2026, quando serve nell’IDE e quando una chat. Esempi reali, limiti del “gratis” e scelte di metodo

Introducendo l’AI nelle PMI si riducono tempi, costi, errori e lavoro manuale nel software aziendale

L’AI nelle PMI riduce rischi e costi nascosti, riportando coerenza nelle regole di business senza bloccare l'operatività.

Il problema delle allucinazioni dell'AI, le risposte inventate e come eliminarlo

Le allucinazioni dell'AI generano risposte false ma plausibili. Con la RAG puoi ridurle e rendere i sistemi più affidabili.

Software con Intelligenza Artificiale in ambito finanziario

Come l’Intelligenza Artificiale sta rivoluzionando il settore finanziario, con esempi concreti di software reali da sviluppare in .NET

Visual Studio 2026 è il trucco legale che ti fa correre più veloce degli altri

Visual Studio 2026 introduce funzioni che eliminano attriti e rallentamenti, rendendo il lavoro più fluido, veloce e soddisfacente.

Come usare i LLM come Copilot nei tuoi progetti .NET senza diventarne dipendente

Integra i LLM nei tuoi progetti .NET per aumentare produttività e qualità, evitando dipendenze e mantenendo pieno controllo architetturale.

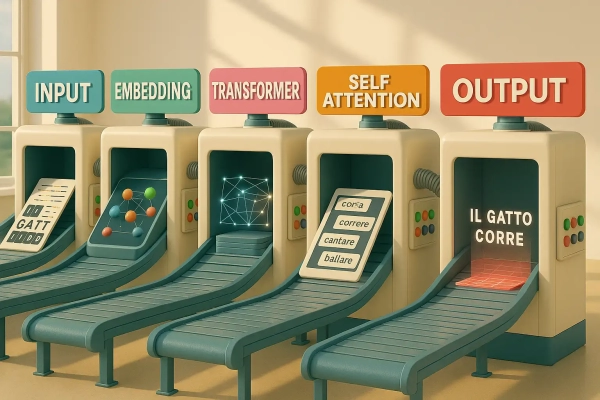

I modelli di linguaggio spiegati semplice niente magia solo numeri

Come funzionano i modelli di linguaggio? Non pensano, calcolano. Scopri gli strumenti nascosti che li guidano e impara a usarli .

AI e machine learning per sviluppatori .NET: non accontentarti di una scatola nera che spara risposte a caso

Per uno sviluppatore .NET l’AI e il Machine Learning sono essenziali: con il ML puoi tracciare decisioni, evitando risposte non controllabili.

Come la programmazione con l’AI abbatte le complessità: il metodo rodato

La programmazione con l’AI ti dà gli strumenti adatti per ogni progetto. Le strategie per eliminare gli errori nascosti e dominare il codice.

Scopri la computer vision per l’elaborazione delle immagini e come insegnare a una macchina a vedere davvero

Impara a usare la computer vision e l'elaborazione delle immagini con esempi concreti, tecniche efficaci e applicazioni reali.

Con l’XAI puoi capire realmente cosa succede davvero dentro l’IA

XAI è la chiave per interpretare le decisioni della tua IA e costruire fiducia nei modelli predittivi.

A che punto è l'intelligenza artificiale e dove arriverà a breve l'AI generale

Un'analisi profonda sull'AI moderna e sul percorso verso l'AGI: cosa può fare oggi, come viene testata e cosa ci aspetta nei prossimi anni.

Gli LLM capiscono tutto, tranne ciò che non sai chiedere

Dietro ogni risposta brillante c’è un LLM che puoi imparare a sfruttare. Scegli di non subirlo, ma usalo con consapevolezza

Usare intelligenza artificiale in modo avanzato: la mente guida, la tecnologia obbedisce

Scopri come usare l’intelligenza artificiale in modo avanzato. Un metodo mentale e operativo per chi ragiona, crea e guida la tecnologia

Il futuro della programmazione: le skill che tutti gli sviluppatori dovranno avere (o saranno fuori dal gioco)!

Il futuro della programmazione sta cambiando con l'intelligenza artificiale: quali lavori sono a rischio e come restare competitivo nel nuovo scenario

L’Intelligenza Artificiale sostituirà i programmatori? La verità sul futuro del coding

Temi che l'Intelligenza Artificiale sostituirà i programmatori? Scopri perché il tuo ruolo è fondamentale e come l'AI può diventare un alleato.

Come diventare programmatore di intelligenza artificiale da zero a professionista

Trasforma la tua passione in carriera tech e scopri come diventare programmatore di intelligenza artificiale.

Programmare con l'intelligenza artificiale: marketing ingannevole o la tua nuova carriera?

Programmare con l'intelligenza artificiale non serve. Scopri con noi perché un corso di programmazione ti garantirà un futuro lavorativo migliore.

Mira Murati saluta OpenAI: cosa insegna la sua scelta ai futuri leader tecnologici come te

Scopri perché Mira Murati ha lasciato OpenAI e come la sua esperienza può ispirarti a diventare un architetto software di successo.

Intelligenza artificiale per programmare: come migliorare e accelerare il tuo codice

Scopri come usare l'intelligenza artificiale per programmare e migliorare il tuo codice in modo più efficiente.

Sfrutta l'intelligenza artificiale e diventa un esperto con il corso AI Microsoft

Vuoi padroneggiare .NET grazie alla AI? Scopri il Corso AI Microsoft e trasformati in un professionista ricercato nel settore.

Il futuro degli sviluppatori nell'era dell'intelligenza artificiale generativa in un'analisi approfondita sull'evoluzione della programmazione

Scopri come l'intelligenza artificiale generativa sta rivoluzionando lo sviluppo software. Strategie per adattarsi e prosperare nell'era dell'AI

Cosa sono gli LLM e come cambierà per sempre il modo di programmare e comunicare

Scopri cosa sono gli LLM e come stanno rivoluzionando la programmazione e la comunicazione, trasformando per sempre il modo di lavorare di tutti.

Sviluppare con l'intelligenza artificiale per iniziare a programmare in modo semplificato!

Scopri come sviluppare l'intelligenza artificiale può semplificare il tuo percorso di apprendimento nello sviluppo software!

Quando gli LLM diventano una leva reale

Gli LLM diventano una leva reale quando sono collegati a processi, dati e casi d'uso concreti. Senza integrazione restano una demo impressionante; con metodo, diventano assistenti, motori di ricerca semantica, interfacce intelligenti e acceleratori di produttivita per team tecnici e aziende.

Domande frequenti

L'integrazione piu comune avviene tramite Semantic Kernel, la libreria Microsoft che astrae le chiamate ai modelli OpenAI, Azure OpenAI o locali. In alternativa si usa direttamente l'SDK di OpenAI per .NET. Il pattern tipico prevede una pipeline con memoria, plugin e orchestrazione delle chiamate al modello, non una semplice chiamata HTTP.

Semantic Kernel e un framework open source Microsoft per orchestrare modelli AI in applicazioni .NET, Python e Java. Va usato quando hai bisogno di comporre piu chiamate al modello, gestire memoria conversazionale, integrare tool e plugin o costruire agenti autonomi. Per chiamate singole e isolate un SDK diretto e piu semplice.

Con .NET puoi usare GPT-4o e i modelli OpenAI tramite l'SDK ufficiale, i modelli Azure OpenAI tramite Semantic Kernel, modelli open source come LLaMA o Mistral tramite Ollama in locale, e qualsiasi API compatibile con lo standard OpenAI. La scelta dipende da requisiti di privacy, latenza, costo e qualita delle risposte nel tuo dominio specifico.

Chi conosce l'AI sa dove inserire un LLM nell'architettura senza trasformarlo in un collo di bottiglia, come gestire i costi di token, quando la generazione contestuale vale il trade-off con la latenza e come fallback su logica deterministica quando il modello non e affidabile. Chi non la conosce tende a usare l'AI come feature decorativa o a costruire dipendenze fragili.

Fonti e riferimenti

Attention Is All You Need, Vaswani et al., 2017

Il paper che ha introdotto l'architettura Transformer.

OpenAI developer resources

La documentazione ufficiale di OpenAI per le API GPT, embeddings e function calling. E indispensabile per capire i limiti reali dei modelli, la struttura dei prompt, i costi e la gestione del contesto. La cito perche molti articoli sul tema trascurano proprio questi dettagli tecnici che invece fanno la differenza tra un prototipo e un sistema in produzione.